{{!completeInfo?'请完善个人信息':''}}

精准高效领先的融资对接服务

了解AI行业的发展动态、策略和挑战。

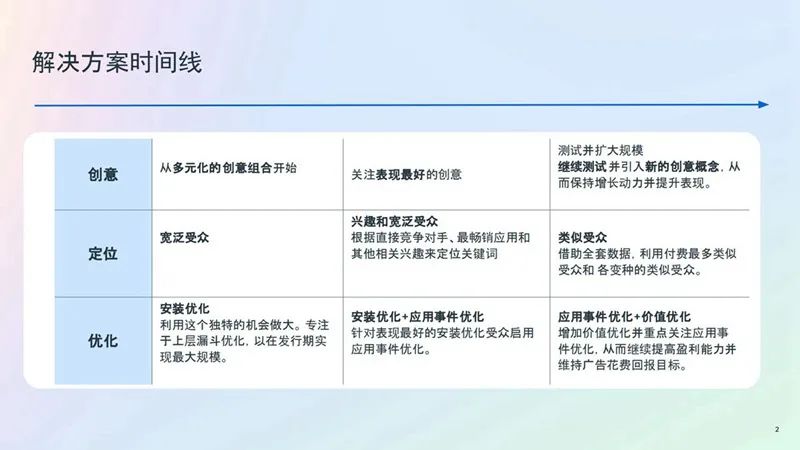

首先,我们来看传统的一些出海问题及其解决方案。

在网络层面上,腾讯云提供了多种加速解决方案,实现数据传输高速、稳定、安全、合规。

在安全层面上,安全始终是我们出海用户的关注重点。腾讯云的Edgeone资源遍布全球70+国家与地区,通过在全球3000+个边缘节点上部署,整合了DNS解析、智能加速、DDoS防护、Web防护、Bot防护等安全防护和加速服务两大能力体系,为全球客户提供安全、灵活、高效及敏捷一体化服务。

在资源分布层面上,腾讯云全球基础设施已经非常成熟,遍布全球五大洲20+地区,200万+服务器,300T公网出口带宽,为出海客户打造全球高性能、高稳定性的基础设施服务。

其次,我们在AI大模型时代出海面临着哪些新的问题?

首先成本控制问题是大家最为关注的问题,特别是AI大模型时代,成本井喷是常态,如何增效降本是首要解决的问题。

而容器技术就是增效降本的非常好的抓手。腾讯云通过:

1)TKE容器的QGPU技术,支持多个容器共享 GPU 卡,精细切分 GPU 算力占比和显存大小 ,将GPU 利用率压榨到极致。

2)通过tke容器原生节点 调整request/limit,提高装箱率,从而成倍提高cpu和内存利用率,大大降低服务器使用量。

3)容器超级节点Serverless 弹性容器服务,秒级弹性,无服务器、按需使用,细颗粒度的节约成本 。

除容器技术以外,通过:

1)内存压缩 悟净技术,在保障业务内存使用性能前提下,将较冷的内存换出至较便宜的设备上,从而降低整机的内存消耗,平均降低内存30%以上。

2)cls极致提效技术,成本,检索,分析 三大核心能力10倍提升,平均降本50%以上, 除此之外还有很多降本技术方案, 正是基于这些技术点,腾讯云帮助用户建立了一整套降本体系。整体技术降本效果达到30%。

AI大模型时代在全球精细化运维管理能力上越来越复杂,因此腾讯云提供了客观观测平台和故障自愈功能,以应对7X24小时全球高效运维管理的挑战。

此外,腾讯还提供了很多大模型最佳拍档产品,如向量数据库和大模型知识引擎,快速帮助用户降低难度、提高效率。

最后 在AI大模型时代,有哪些创新解决方案和服务模式?

腾讯云构建了一套一站式大模型解决方案。提供了一套全链路产品矩阵,涵盖从底层丰富基础设施到顶层多元智能应用。包括自研通用大模型、模型开发平台、智能体开发平台,以及针对不同场景定制的智能应用解决方案等。

特别是数据准备和精调训练阶段:平台提供极致灵活高效的数据构建与标注能力,包括3大类数据处理pipeline,以及5大高质量处理环节,如原始数据分析、数据清洗、数据去重等。此外,平台还基于腾讯云的实战经验,沉淀了覆盖12大类LLM应用场景的100多万条精调配比数据,有效提升模型效果。

在精调训练阶段,支持一键启动精调任务。通过 硬件容错、容器调度、任务断点续训 保障大规模训练稳定运行,基于自研的Angel训练框架,整体提升30%的训练性能,显著提升任务成功率及资源利用率。

在这套方案中,除一站式解决方案外,还加入腾讯云的实战经验和自研工具,大大帮助了出海客户高效地将大模型技术应用到全球实际业务场景中,实现快速部署和价值创造。

在客户服务层面 ,腾讯云突出全球一体化的服务模式。服务团队由售前解决方案 、 tam售后专家、 及7X24小时线上售后专家团队组成,全部为原厂技术专家及产品研发工程师,确保了全球7X24小时实时技术支持的高效性和专业性。彻底解决海外服务难题。

通过实际案例,腾讯云展示了如何帮助出海车企提高问答准确率和知识构建效率,以及如何为出海在线教育企业降低成本和提升资源利用率。

总之,腾讯云致力于提供满足AI大模型时代出海客户需求的云服务,通过创新的解决方案和服务模式,帮助客户克服挑战,实现业务的持续增长。

原文链接:点击前往 >

文章作者:扬帆出海

版权申明:内容仅供网友参考学习。如有侵权,请联系客服,扬帆出海欢迎行业优质稿件投稿。扬帆出海为您提供中国互联网出海权威资讯,提升出海认知;对接全球企业合作资源,构建企业本地化壁垒;10万+出海从业者社群,帮助打通行业人脉。 更多资讯关注扬帆出海官网:https://www.yfchuhai.com/

{{likeNum}}

好文章,需要你的鼓励

已关注

已关注

关注

关注

微信号:yfch24

微信号:yfch24

小程序

公众号

社群