{{!completeInfo?'请完善个人信息':''}}

精准高效领先的融资对接服务

2002年亚马逊发布了云服务平台Amazon.com Web Services (AWS),最初主要提供商品数据库的互联网调用服务。经过四年的产品迭代和需求探索,AWS推出了S3存储服务和EC2算力服务,最终发展成为全球最大的云计算平台。

摘要

当前大模型应用面临着市场需求不明确和用户留存率低的挑战。企业正在探索如何将大模型应用与市场需求相结合,以促进其发展。

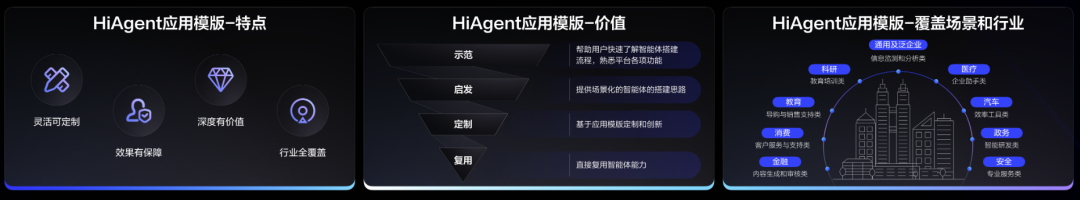

字节跳动推出了HiAgent平台,旨在帮助企业快速开发大模型应用和Agent。HiAgent被比喻为企业开发应用的SDK,它封装了企业开发AI应用的工具,简化了开发流程。

HiAgent通过与客户的合作,如浙江大学和一家头部电池公司,展示了大模型应用在不同场景下的实际应用和挑战。这些合作帮助HiAgent迭代和升级,以更好地满足企业需求。

大模型的兴起为云计算市场带来了新变量,所有云平台在这一增量市场上基本处于同一起跑线。大模型的应用开发依赖于底层模型和基础设施,为新兴创业公司和云平台提供了新的机会。

2002 年夏天,亚马逊发布了云服务平台 Amazon.com Web Service,开发者可以通过互联网调用亚马逊的 “宝贵资产”——商品数据库,比如书名、出版书号、价格信息。在淘宝还没诞生的年代,这是个开创性的做法,不过这很显然也没什么价值。当时基于它做出的最有用的产品可能是发书号查售价。

但之后经过 4 年的需求探索、产品迭代,这个平台往前走了一大步,发布了通过互联网调用存储空间的 S3 服务和调用算力的 EC2,最终演化为全球最大的云计算平台 AWS,撑起万亿美元市值。

突破性的新技术、伟大的产品诞生之初,往往都是从一些前景不明的实验开始,经过一次次迭代找到与市场需求的契合点,再发展壮大。YouTube 最早是一个视频约会网站,字节的第一个内容产品没用上推荐算法,iPhone 诞生时没有应用商店。

现在的大模型应用就在这样一个阶段。消费者甚至开发者已经开始质疑市面上的 AI 应用到底有什么用。数据调研机构 IDC 在 9 月发布报告称,市面上率先发布的 Chatbot (聊天机器人)应用,无论定位是个人助理还是情感陪伴助手,30 日用户留存率都普遍较低,只有 6% 左右。

整个行业都在寻找突破口。OpenAI 不断给 ChatGPT 叠加新功能;微软、Google 等海外大公司把 AI 应用嵌入成熟的互联网产品中,带动更多用户使用;所有公司在过去一年都看上了 Agent(智能体),让大模型调用工具和数据库,找应用前景。

字节跳动没有放过任何一种可能性,除了开发 10 多个直接面向消费者的大模型产品,也在企业服务市场全面布局。

12 月 18 日,字节跳动旗下云计算平台火山引擎举办冬季 FORCE 原动力大会,升级豆包系列基础模型,推出视觉理解模型,并重点介绍了一款此前外界感知不多的产品——HiAgent。

HiAgent 是一个平台产品,目标是帮助企业迅速开发大模型应用和 Agent。“如果把豆包大模型比作 Android,那么 HiAgent 就是企业调度系统能力开发应用的 SDK(软件开发工具包)。” 火山引擎副总裁张鑫说。

过去一年多,张鑫走访了上百家企业。他看到多数公司都尝试开发大模型应用产品,用来提升业务效率,但基本没有哪个公司当下能判断,具体怎么用最有效。

没人知道大模型未来到底该怎么用,但也没人敢错过这样一个机会。企业需要一个上手门槛低,能够快速试错的大模型应用开发平台。而这个平台也需要尽可能丰富的企业参与使用,让自己快速迭代。

爆款 AI 应用还不明确,先做平台

HiAgent 不是一个反复推演终局、谋定而后动的产品。今年 1 月,张鑫有了初步想法后向火山引擎总裁谭待汇报,之后组建了一个十多人的小团队就启动开发,边测试边迭代。

2023 年初,ChatGPT 的冲击传导到国内,引发大模型开发热潮。火山引擎在 2023 年 4 月举办发布会,谭待说中国做大模型的公司七成在火山引擎云上。两个月后,火山引擎发布的大模型服务平台 “火山方舟”,为企业客户提供大模型精调、推理、评测、部署等服务。

到了年底,大模型云计算市场格局开始发生变化。随着海外开源模型的成熟,中国企业从头自研大模型的热情开始退却,直接购买 GPU 算力的客户大幅减少。有限的客户也面临着更激烈的竞争——阿里投资了多家领先的大模型创业公司,一部分投资额度被折算为阿里云算力资源。

另一方面,则是大模型调用成本下降,企业客户开发大模型应用的热情高涨。火山引擎内部迅速达成共识:大模型的算力使用,将从训练大模型为主转移到使用大模型(推理)为主。

火山引擎原有的方舟平台能够满足一部分需求,但它依然是一个极其依赖开发和工程经验的产品。“它本质上是一个高代码工具。” 张鑫说,对大多数企业来说仍有一定的上手难度。

今年 2 月,字节跳动在国内推出 AI 应用开发平台扣子,把各种大模型封装成一个个 API 接口,开发者可以用它快速调用大模型,开发、调试和优化 AI 应用。

扣子扩大了字节大模型企业服务方向的覆盖范围,但还是没有完全解决传统企业探索 AI 应用的需求。

火山引擎将这种需求概括为五个方面:AI 专业人才不足、企业担心数据泄露、专属应用开发难、集成到业务系统中麻烦和效果难以评估。这些不完善共同构成了 HiAgent 发挥价值的空间。

他们给 HiAgent 设定的目标是更懂 AI 转型,更深入地适配业务、更看重安全保障,“让每个人像拼乐高一样搭建 AI 应用”,具体的做法是把企业开发 AI 应用的工具封装成 “聊天机器人”“插件”“工作流”“知识库” 等模块,方便调用。

在张鑫看来,当前大模型应用的真实需求并不明确,所以敏捷开发、迅速试错的能力是关键。这是字节跳动开发产品的方法论之一,也是火山引擎希望赋予 HiAgent 的核心价值。

为了刺激企业客户需求,他们给大模型应用设定了成熟度等级。“企业没有一个可以循序渐进的路径,导致他们投资开发 AI 应用时犹豫,不知道该跟着技术发展成长,还是等到技术成熟后一步到位。” 张鑫解释说,对于开发 AI 应用的企业来说,他们也很难评估身位。

划定等级是新技术兴起时行业的惯用做法,比如自动驾驶领域就有 L0 到 L5,从人类介入的程度来评判技术水平。但此类分级体系往往充斥着大量专业术语。火山引擎则是借用游戏中的段位 “青铜”“黄金”“王者”,降低理解成本。

火山引擎根据大模型的能力范围,为 HiAgent 锚定两类未来有爆发空间的方向:

-

人力密集且人员流动大的场景,代表是客服和导购。企业往往难以找到一种高效的方法培训员工,把必备技能标准化。而大模型可以从海量的数据中,提炼出这些领域员工所需遵循的模式,帮企业降低成本。

-

知识密集且人员成本高的场景,代表是科研、教育和法律。在这些领域,专家凭借其长期的知识沉淀为企业带来极高价值。大模型能从海量文献资料中深入学习,虽然短期达不到顶级或资深专家的水平,但可以解决一部分初级或中级需求。

从 100 多个客户的反馈中,提炼出 3 个趋势

今年 5 月 15 日,HiAgent 正式上线。同期,火山引擎平台的豆包大模型大幅降价,HiAgent 迅速成为火山增长最快的企业服务产品之一。

据张鑫介绍,HiAgent 上线 7 个月,已经签下 100 多个客户,从宁德时代、飞鹤等不同领域的巨头,金融行业的华泰证券、国信证券,高校中的浙大、南开等。

这些客户为火山引擎带来新收入的同时,也帮助 HiAgent 迭代。12 月 18 日,火山引擎发布 HiAgent 的 1.5 版本,核心功能的升级来自他们观察到的 AI 应用落地趋势。

开发 AI 应用的人,可以不会写代码

HiAgent 上线后不久,火山引擎谈下了浙江大学。这次合作出乎张鑫意料。

在浙大这个项目上,他们此前已经做好了准备,要像推广云平台服务时那样,不仅负责平台的使用培训,还要下场开发一些应用,“但上线一周,他们就做出来了 6 款应用,包括科研助手、课堂问答、教务问答、百事通及本地生活助手等。”

开发这些应用的主力是浙大的老师、学生和浙大校园各种信息系统的服务商。“原本应用开发流程,是使用者提需求,让 IT 开发,容易出现使用者等很久,结果功能没达到预期的情况。” 张鑫说,“现在最懂业务的人直接变成了开发者。”

在他看来,这个变化意味着,原来云计算行业经常遇到的两个麻烦都有了解决的可能。一是大多数云计算产品都处于软件底层,企业采购应用后很难直接看到效果。现在开发流程简单,可以 “所见即所得”。另一个是,云计算厂商开发的低代码软件开发应用经常陷入尴尬:“专业客户看不上低代码平台,觉得限制大;小白客户觉得难,大多数都不会用。”

火山引擎也在服务国家管网等其他客户使用 HiAgent 的过程中,看到了类似的情况。基于此,他们为 HiAgent 设定的第一个功能特点就是 “普敏捷”,看重降低平台的使用门槛,让更多人能够开发 AI 应用。这次发布会上,火山引擎还发布了 HiAgent 上的 100 种行业 “样板间”,企业客户可以一键复刻,使用模板开发应用。

想更好解决问题,大模型需要知识增强

另一个让张鑫印象深刻的客户是一家头部电池公司。与浙江大学一周就催生出多大模型应用不同,那家公司的业务场景更复杂,火山引擎和他们投入了数十人、花了半年才推动 HiAgent 初步落地。

火山引擎谈下那家电池公司时,对方已经梳理好了上千种可能引入 AI 的业务场景,这些场景覆盖内部流程提效、研发辅助、市场营销等多个领域。而且他们已经组建团队,尝试开发大模型应用,但通常需要花费一个月甚至更长的时间。

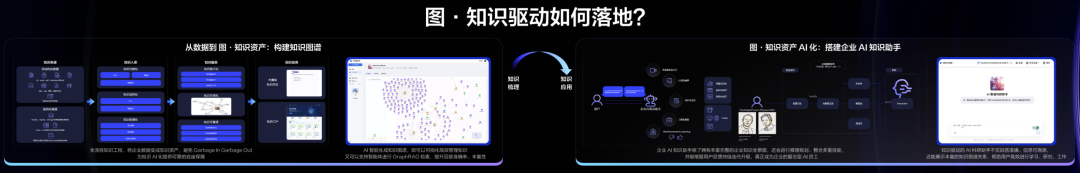

HiAgent 可以加快应用开发的速度,但难以快速解决电池公司遇到的根本问题——如何清洗公司过去 10 多年积累的文档,把它们变成大模型方便调用解决问题的工具。

在这次合作中,他们也对大模型在企业中应用的局限有了更深的感受:大模型只能回答问题,并不能提出问题;只能提炼分析知识,不能创造新知识;只能理解特定结构化的知识,无法处理好离散的数据体系;以及无法完全理解现实世界的规律,仍然存在幻觉。

“关键是做好知识工程。” 张鑫说,与头部电池公司合作的大多数时间,双方都是在做知识增强工作,为大模型应用发挥作用打基础。

当前的大模型行业,有一套常用的企业应用开发流程:先用企业专有数据精调大模型或者把它们做成向量数据库,用检索增强的方法(RAG)交给大模型调用,以解决问题。

“但数据到知识还有很深的鸿沟,甚至真正的知识并不在企业的文档或者数据库里,而是在员工的脑子和经验中,以及企业的决策流程中。” 张鑫把他们的行动描述为一场 “融合技术手段的社会工程”。

基于原有的文档和数据,他们访谈了一批那家电池公司各个领域的专家,从他们处理业务的行为模式和交流记录中提取信息,建成知识库。训练好模型之后,他们召集了一批员工给模型的答案反馈,做基于人类的反馈强化学习,根据现实的情况校准模型(对齐)。

在这个判断的基础上,火山引擎提炼出 HiAgent 的第二个功能点 “图知识”,用 GraphRAG 等技术,更好地处理离散的文档和碎片化的信息,建立知识之间的关系信息,帮客户梳理更能发挥大模型能力的知识库,从而提升大模型的逻辑推理能力。与传统 RAG 相比,GraphRAG 也能让大模型的回复更准确。

“沉淀知识资产,是客户更愿意买单的地方。” 在张鑫看来,强大的大模型普及会抹平许多企业的竞争优势,知识增强工程会成为新的竞争力。

只有大模型聊天机器人不够,需要更丰富的交互方式

ChatGPT 兴起后,验证了大模型理解、处理自然语言的能力,行业中也加大了对自然语言交互的关注,并形成共识:自然语言交互(LUI)将变得更加普遍,会是大模型时代的主要交互方式,就像手机与电脑时代的图形交互(GUI)那样。

聊天机器人也成了大模型应用的主要形态,迅速发展。根据市场调研机构 Mordor Intelligence 数据,2024 年聊天机器人规模将达到 70 亿美元,5 年后会增长到 208 亿美元。

在电池行业落地 HiAgent 的过程中,张鑫看到只靠聊天机器人做大模型完全不够。“大模型一定会与企业内部流程和工具的融合”,他说尤其是在严肃的生产场景,一定是 “大小模型结合”,许多问题如果让通用大模型解决耗时耗力,但一个成熟算法反而可以迅速解决。

想把各种大模型应用嵌入到流程中,需要有一个统一的框架或平台,否则每次开发一个应用,都需要重新与业务系统和各种工具重新对接。火山引擎的做法是,把企业内部系统中用到的工具、算法,做成方便大模型应用调用的插件,汇总在插件中心方便开发。

现在许多使用 HiAgent 的企业在内部建立了类似的大模型应用系统。火山引擎因此提出了 HiAgent 的第三个功能点 “富交互”,推出融合自然语言交互和图形交互的 “生成式画布” 功能。

这些核心功能点之外,火山引擎也给 HiAgent 增加了 “AI 咨询” 服务,将其作为一个独立的商业产品。“大模型应用要做成功,云厂商的技术只能解决一半的问题,另一半要靠企业。” 张鑫说,企业积累数据和知识,在日常业务中调教 AI 系统是一个漫长过程,云计算厂商提供的帮助有限,但可以用咨询的方式,为他们带来一些启发。

大模型 to B,云计算的新变量

云计算是一个对后发者不友好的行业。企业长期使用一家云平台时,不仅会把数据迁移其中,开发者也会接受云平台制定的开发模式。企业想要再迁出会付出很大代价。

云计算也是一门规模效应明显的生意。先发者积累大量的客户后,不仅可以向上下游谈判定价,还可以根据用户使用资源的时间差,卖出更多的算力资源,从而获得更大幅度的降价空间。

曾在 Google Cloud 工作的张鑫亲身经历过后来者的追赶。Google 一开始想用 Web 应用程序开发和托管平台 App Engine 取胜。但它不够简单,功能也不如企业地内部系统完善,而且当时的客户更在意弹性的算力和存储空间等基础资源。后来 Google 开源了容器化应用程序 K8s,方便使用云平台的客户迁移。

张鑫也因此创办才云科技,提供 K8s 为基础的云服务。他观察到,K8s 让客户不再那么依赖单个公共云平台,“但有客户用了 K8s 后,发现不需要用公共云了”。2020 年,字节跳动收购才云科技,张鑫跟着加入火山引擎。

火山引擎副总裁张鑫。

火山引擎正式对外提供服务时,中国的云计算行业已经发展多年,竞争激烈,但渗透率有限。它们面临共同的难题:云计算平台依赖的电力、带宽等基础设施成本不受企业控制,还有很多传统企业因为各种原因自建数据中心。

大模型是云计算市场的新变量。大模型的基础设施严重依赖 GPU,而不是原有云计算平台曾大力投入、建立规模优势的 CPU 芯片。在这个增量市场上,所有的云平台基本在同一条起跑线上。

大模型的爆发也会催生一批新的创业公司。“它们往往不是云计算领域的传统客户。” 张鑫说,这是一个比肩互联网、移动互联网起步的机会,市场上原本的大型云平台,都是跟着新技术变革发展壮大。

大模型应用开发更依赖底层的模型和基础设施。“就算是开源模型,如果没有一个好的基础设施,很难跑起来。” 张鑫说,“想要开发一款好的大模型应用,也离不开配套的工具。如果做多模态应用,还要调用语音、图片等模型。”

2023 年开始,字节训练了一批基础模型,囊括语言、语音、图像生成、视频生成等所有主流方向。

在这些大模型的基础上,字节开发豆包、猫箱、扣子 等的 10 多个 C 端产品,其中豆包 App 日活在中国大模型产品中排名第一,远超第二名。字节还通过火山引擎开放模型 API,抢占企业市场。今年 5 月,火山引擎大幅降低豆包大模型的调用价格,核心语言模型的定价一度比同行低 99.3%。

到了年中,中国的大模型行业显露出疲态时,字节进一步加大投入,招揽一批人才。

HiAgent 是火山引擎在大模型企业服务市场的最新动作之一。和 K8s 不一样,HiAgent 与豆包大模型相互拉动:字节训练的一系列大模型是 HiAgent 的基础,豆包 App 等消费者产品也可以为 HiAgent 等产品导流……反过来,HiAgent 也是企业客户使用豆包大模型的入口,让他们快速开发 AI 应用,带动豆包等基础模型和算力的消耗,帮助字节迭代和完善大模型基础设施和产品。

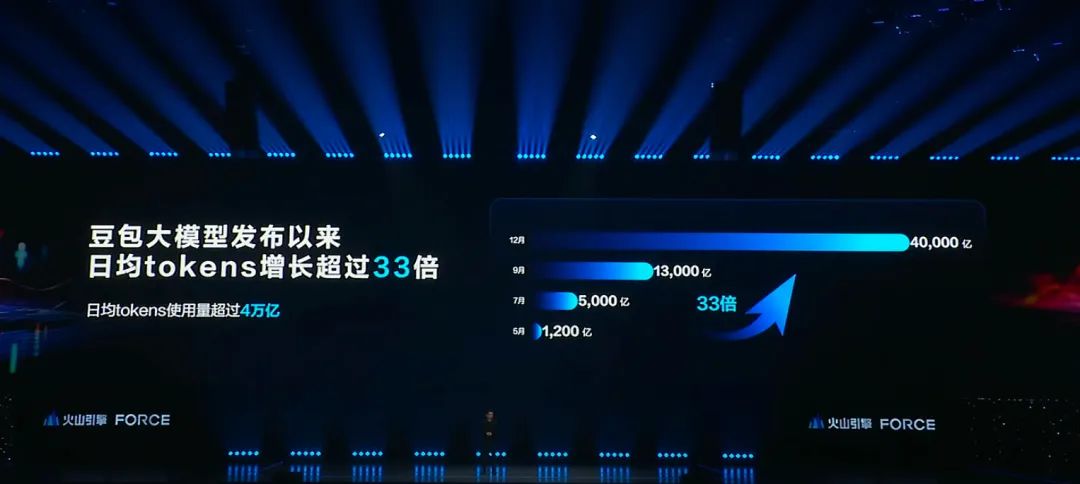

火山引擎总裁谭待介绍,今年 12 月,豆包系列模型的日均 tokens 使用量超过 40000 亿,是 5 月的 33 倍。

根据市场调研机构 IDC 数据,今年上半年,没有投资一家大模型创业公司的火山引擎在中国大模型 IaaS 市场份额排在第二,仅次于阿里云。

我们了解到,火山引擎在大模型领域的增长也在带动其传统云计算服务。目前火山引擎一定比例的 CPU 算力、数据库等需求来自大模型客户。

每一轮颠覆式新技术的诞生都是一批公司弯道超车的机会。这既是应用大模型的企业的机会,也是为企业提供大模型支持的平台的机会。

原文链接:点击前往 >

文章作者:晚点LatePost

版权申明:文章来源于晚点LatePost。该文观点仅代表作者本人,扬帆出海平台仅提供信息存储空间服务,不代表扬帆出海官方立场。因本文所引起的纠纷和损失扬帆出海均不承担侵权行为的连带责任,如若转载请联系原文作者。 更多资讯关注扬帆出海官网:https://www.yfchuhai.com/

{{likeNum}}

好文章,需要你的鼓励

已关注

已关注

关注

关注

微信号:yfch24

微信号:yfch24

小程序

公众号

社群