{{!completeInfo?'请完善个人信息':''}}

精准高效领先的融资对接服务

阿里巴巴开源了QwQ-32B大模型,支持Apache 2.0开源协议,可用于商业化。该模型在多个主流测试基准中表现优异,与DeepSeek的R1-671B和OpenAI的o1-mini相当,但参数量仅为320亿,远低于R1的6710亿参数,显著降低了部署和推理成本。

摘要

QwQ-32B通过大规模强化学习实现高性能,特别是在数学和编程任务的冷启动阶段,采用校验生成答案正确性和代码执行反馈的方式进行训练。这种方法能够更精确地评估推理过程和代码的实际运行效果,从而提升模型的深度思考和复杂推理能力。

模型训练分为多个阶段:初始阶段针对数学和编程任务进行强化学习训练;后续增加通用能力的强化学习训练,使用通用奖励模型和基于规则的验证器,提升模型的逻辑性、连贯性和通用性。不同阶段的训练具有互补性和兼容性,能够在不影响特定任务性能的前提下提升整体通用能力。

QwQ-32B集成了Agent相关能力,能够在使用工具时进行批判性思考,并根据环境反馈调整推理过程。例如在智能客服场景中,Agent可以根据用户反馈调整回答策略,提升交互体验。

大规模强化学习为模型性能提升提供了新的方向,尤其在动态交互和策略优化方面表现出色。通过冷启动数据和多阶段训练,模型能够在复杂任务中逐步提升性能。此外,强化学习提高了参数利用效率,使得较小规模的模型也能达到与大规模模型相当的性能,为行业提供了新的技术思路和实践方向。

阿里巴巴开源了最新大模型QwQ-32B,并且支持Apache 2.0 开源协议可以商业化。

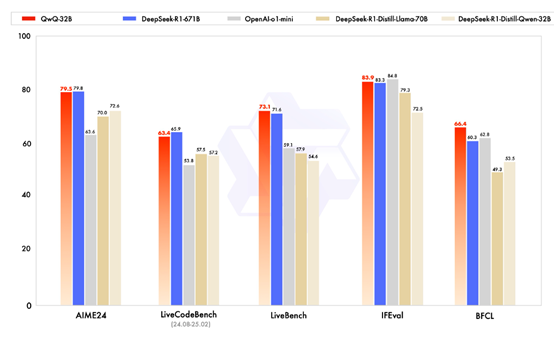

根据阿里公布的测试数据显示,QwQ-32B在AIME24、LiveCodeBench、LiveBench、IFEval等主流测试基准中,可以媲美DeepSeek开源的R1-671B和OpenAI的o1-mini。

但QwQ-32B只有320亿参数,而R1拥有6710亿参数,体量大降了20倍以上。在部署、推理效率、成本方面非常出色。

开源地址:https://huggingface.co/Qwen/QwQ-32B

体验地址:https://chat.qwen.ai/

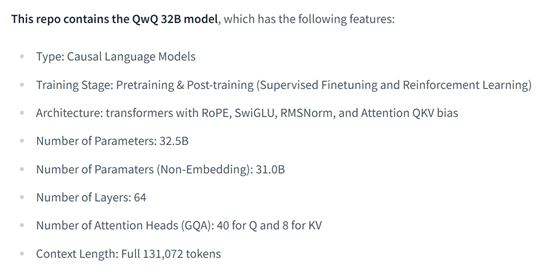

QwQ-32B能以如此低的参数获得这么高的性能,主要是应用了大规模强化学习来实现,从而具备深度思考和复杂推理能力。

在冷启动基础上开展大规模强化学习,初始阶段针对数学和编程任务进行 强化学习 训练具有重要意义。与传统依赖奖励模型不同,阿里通过校验生成答案的正确性为数学问题提供反馈,通过代码执行服务器评估生成代码是否通过测试用例来提供代码反馈。

在数学解题中,传统的奖励模型只是简单地根据答案是否正确给予固定奖励,而阿里的方法能够更精确地评估答案的推理过程是否正确。例如,对于一道复杂的数学证明题,传统奖励模型可能只关注最终结论是否正确,而阿里的校验方式可以对证明步骤的每一步进行分析,若某一步推理错误,则给予相应的负反馈,促使模型改进推理过程。

在编程任务中,通过代码执行服务器评估代码是否通过测试用例,能够让模型快速了解代码的实际运行效果,从而更有效地改进代码生成策略。

例如,在开发一个简单的排序算法程序时,模型生成代码后,通过执行服务器运行代码并检查是否能正确对给定数据进行排序,若不能通过测试用例,模型可以根据错误提示和反馈调整代码生成逻辑。

第一阶段之后,会增加针对QwQ-32B通用能力的强化学习训练,使用通用奖励模型和基于规则的验证器进行训练。

通用奖励模型可以从更广泛的角度对模型的行为进行评估,例如在文本生成任务中,不仅评估生成文本的语法正确性,还评估文本的逻辑性、连贯性等。

基于规则的验证器则可以根据一些既定的规则对模型输出进行验证,如在信息抽取任务中,验证抽取的信息是否符合特定的格式或语义规则。通过少量步骤的通用 强化学习,模型在提升其他通用能力的同时,在数学和编程任务上的性能没有显著下降,这表明不同阶段的 强化学习 训练之间具有一定的互补性和兼容性,能够在不影响特定任务性能的前提下提升模型的整体通用性。

此外,阿里还在QwQ-32B中集成了与 Agent 相关的能力,使其能够在使用工具的同时进行批判性思考,并根据环境反馈调整推理过程。例如,在智能客服系统中,Agent可以根据用户反馈调整回答策略,类似于人类客服根据用户反应调整沟通方式。

阿里表示,大规模强化学习为模型性能提升带来了新的突破方向,尤其是在动态交互和策略优化方面具有显著优势。通过冷启动数据和多阶段训练,模型能够在复杂任务中逐步提升性能。同时强化学习能够提高模型的参数利用效率,使得较小规模的模型也能达到与大规模模型相当的性能。

原文链接:点击前往 >

文章作者:AIGC开放社区

版权申明:文章来源于AIGC开放社区。该文观点仅代表作者本人,扬帆出海平台仅提供信息存储空间服务,不代表扬帆出海官方立场。因本文所引起的纠纷和损失扬帆出海均不承担侵权行为的连带责任,如若转载请联系原文作者。 更多资讯关注扬帆出海官网:https://www.yfchuhai.com/

{{likeNum}}

好文章,需要你的鼓励

已关注

已关注

关注

关注

微信号:yfch24

微信号:yfch24

小程序

公众号

社群